史上最全事件相机DVS/Event-based Camera的介绍和分析

- 1. DVS 的一些介绍

- 2. 基于事件的视觉传感器发展现状与趋势

- 3. 事件相机的动态范围:

- 信噪比

- 动态范围DR

- 结论

- 4. 新型相机DVS/Event-based camera的发展及应用

- 应用点

- 传统相机的缺点

- 事件相机的优点

- 5. 事件相机在无人驾驶中的应用

- Event-based Camera in Autonomous Driving

- 技术层面的挑战

- 工程层面挑战

- 6. 相关资源/论文

最近本人在看一些事件相机的论文和研究。下面将看的基础内容整理一下,先是一些基本的event camera原理和发展的介绍,后面介绍算法。欢迎讨论!

1. DVS 的一些介绍

模拟生物视网膜特性的仿生相机——事件相机DVS(Dynamic Vision Sensor),该相机具有更宽的动态范围,输出较传统相机而言更稀疏、更快。一种快匹配自适应光流算法和完全通过FPGA完成的基于DVS相机的硬件实现与其功耗和计算速度方面的优势,最后介绍了该项研究在自动驾驶领域的广阔应用前景。

2. 基于事件的视觉传感器发展现状与趋势

目前被广泛应用的事件相机可大致分成3类:动态视觉传感器(DVS)、基于异步时间的图像传感器(ATIS)、动态主动像素视觉传感器(DAVIS,Dynamic and Active Pixel Vision Sensor)。DVS是最基本的也是最先发展的一种事件相机。ATIS像素结构分成两个部分(A和B),包含两个感光器,能够在提供事件信息的同时还能提供一定灰度信息的需求。DAVIS相机将DVS相机和传统的有源像素传感器(APS)相机结合起来,能够同时输出场景事件和灰度信息。

3. 事件相机的动态范围:

事件相机具有高动态范围,相对于传统相机一般只有70dB,事件相机能够达到140dB或更高。

信噪比

Signal to Noise Ratio (SNR),描述传感器所产生的信号与噪声的强度,计算方法是看计算电压还是功率。对于电压信噪比计算,公式为:SNR=10*log(S/N)。其中log为log10,单位是dB。如果噪声是2mV,电压是3V,则信噪比是31.7dB。

log(3000/2)=3.17

对于图像计算来说,一般找一个“精准的”相机拍摄一个基准,再和需要计算的图像进行比较。但基准一般难找,另一种常用的方式是,多次拍摄同一个信号后“求平均值和标准差的比值”。

然而140dB并不是指“信噪比”,但确实和信噪比有关。

动态范围DR

动态范围,Dynamic Range (DR),指“传感器能够分辨的最强的信号和最弱的信号的比值”,计算公式是20log(S/N)。比如说某个电压传感器最高能够测到3V,最小能够测量2mv,则DR是63.4dB。

那么DR和SNR有什么关系么?有关系,SNR和DR的下限有关。如果SNR较差,意味着噪声相对较强,则DR的下界会高,导致DR较小。但SNR和DR的上界无关,DR的上界可以理解为“饱和”的情况。事件相机所说的140dB指的是这个“动态范围”。

结论

140dB指的是动态范围DR,而不是信噪比SNR;

若想真正达到“高动态范围HDR”,必然会有大量的噪声。厂商基本上没有说在动态范围内某个值时噪声怎么样。可以这样理解140dB:“我能够看到很多,但不一定看得清”;

实际使用时,应该结合具体任务,判断特定场景/参数/算法下,能够检测的动态范围。

Source: 事件相机的“140dB”指的到底是什么?

4. 新型相机DVS/Event-based camera的发展及应用

神经拟态视觉传感器使用基于事件驱动的方式来捕捉场景中的动态变化。与传统相机不同,神经拟态视觉传感器没有 “帧” 的概念。当现实场景中发生变化时,神经拟态视觉传感器会产生一些像素级的输出(即事件),一个事件具体包括(t, x, y, p),这里的 x, y 为事件在2D空间的像素坐标,t为事件的时间戳,p为事件的极性。事件的极性代表场景的亮度变化: 上升(positive) or 下降 (negative)。神经拟态视觉传感器对数据存储和计算资源的需求非常小,并且其具有非常低的延迟,可以达到微秒级!!!传统相机在固定频率下产生一系列帧图片,其关键问题是在相邻俩帧之间会丢失掉很多关键信息,并且传统相机在内存,能量损耗以及延迟方面需求过大,这直接导致了很多算法的实时性非常低。以深度学习为例,为了实现目标检测等环境感知任务,不得不利用昂贵的硬件(GPUs)平台为其提供算力支撑。所以神经拟态视觉传感器的研究还是有一定前景的。

-

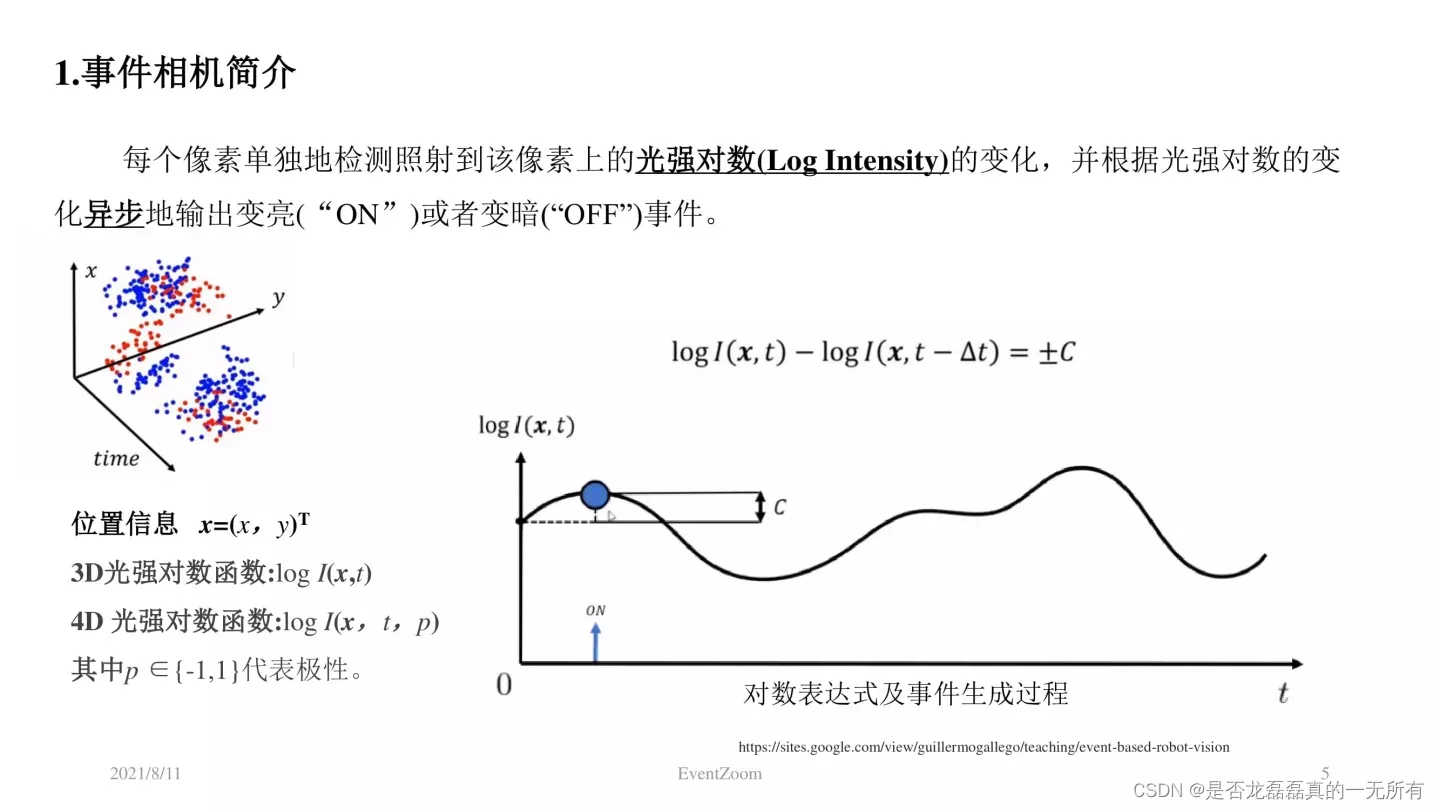

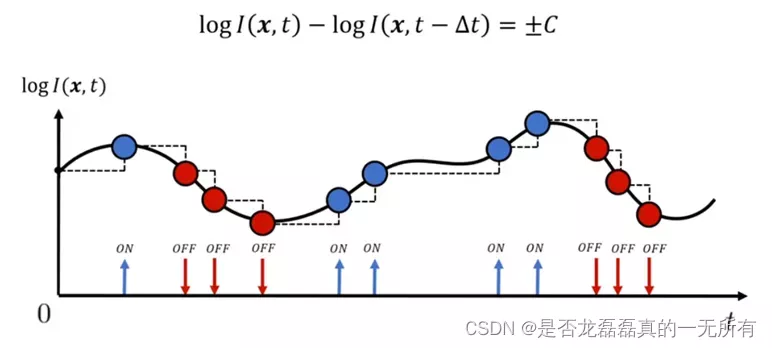

工作原理分析

事件相机的工作原理是对于每个像素的光照对数的变化,根据每个像素的变化,若当前像素的亮度信息变化超过阈值C且为增大,则记为on,若为减小,则记为off事件。对于图中的位置信息设 X = ( x , y ) T X=(x,y)^T X=(x,y)T ,其中 X X X为2维向量,事件可以抽象为3D的函数 E = l o g I ( X , t ) E=logI(X,t) E=logI(X,t) ,或者4D函数 E = l o g I ( X , t , p ) E=log I(X,t,p) E=logI(X,t,p) 其中 p = 1 p=1 p=1 表示ON 信号, p = − 1 p=−1 p=−1 表示OFF信号, p p p代表事件的极性(Polarity)。

-

事件输出Demo

应用点

特征跟踪、SLAM、捕猎机器人,包括物联网(超低功耗监控和智慧城市)、自动驾驶(车辆测距、SLAM和乘员监控)、机器人技术(场景理解与定位)、工业视觉(过程监控和基础设施检测)等。

参考文献:https://www.sohu.com/a/300758196_100007727

传统相机的缺点

帧率低、运动模糊、动态范围低。

传统相机,无论是CMOS传感器,还是CCD传感器,亦或是RGBD相机,都有一个参数:帧率。它们是以恒定的频率拍摄获取图像。这样,即使帧率能够达到1KHz,那也具有1ms的延时。所以传统相机存在一定的延迟问题。

除此之外,传统相机需要通过一定时间的曝光,使感光器件积累一定的光子,那么在曝光时间之内如果物体在高速运动,则会产生模糊,这也是传统相机的一个问题。

另外,传统相机的动态范围较低,具体表现为在光线极差或者亮度极高时,相机获取的信息有限。

以上三点,是由于相机自身硬件的限制,即使高性能相机能够一定程度减小这些问题,但由于相机原理,这些问题无法避免。这些问题极大地限制了一些应用场景。而事件相机完全不存在这些问题。

这意味着有大量的冗余信息和大量不必要的计算需要,导致大的带宽。

事件相机的优点

低延迟、高动态范围、数据量小、极低功耗。

由于事件相机的成像原理,我们可以发现只要亮度一有变化就会输出,且仅输出变化的数据占用了很小的带宽,同时由于事件相机更擅长捕捉亮度变化,所以在较暗和强光场景下也能输出有效数据。事件相机具有低延迟(

-