模式识别基础知识

本文章主要介绍了模式识别的基本概论和统计决策方法(贝叶斯决策)和概率密度函数估计。

一、概论

1.1 模式与模式识别

模式:指需要识别且可测量的对象的描述

模式识别:利用机器(计算机)模仿人脑对现实世界各种事物进行描述、分类、判断和识别的过程。

样本:所研究对象的一个个体

样本集:若干样本集合

类或类别:在所有样本上定义的一个子集,处于同一类的样本在我们所关心的某种性质上是不可分的

特征:指用于表征样本的观测

已知样本:指事先知道类别标号的样本

未知样本:指类别标号未知但特征已知的样本

1.2 模式识别的主要方法

实现的方法可以基于知识的方法和基于数据的方法两大类

- 基于知识的方法:更具人们已知的关于研究对象的知识,整理出若干描述特征与类别间的关系的准则,建立一定的计算机推理系统,对未知样本通过这知识推理决策其类别

- AI专家系统

- 句法(结构)模式识别

- 基于数据的方法:收集一定数量的一直样本,用这些样本作为训练集来训练一定的模式识别机器,使之在训练后能够对未知样本进行分类

- 统计模式识别的方法

- 确定样本的特征——收集已知样本——训练模式识别机器——对未知样本进行分类

- 人工神经网络

- 支持向量机

模式识别研究范畴

- 基于数据的模式识别方法适用于已知对象的某些特征与我们所感兴趣的类别性质有关,但无法确切描述这种关系的情况

- 基于知识的方法是发呢类和特征之间的关系完全可以确切的描述出来

- 若二者的关系完全随机,即不存在规律性练习,应用模式识别也为u发的到有意义的结果。

1.3 监督模式识别与非监督模式识别

监督模式识别

- 已知类别,并且能够获得类别已知的训练样本,这种情况下建立分类器的问题属于监督学习问题,称为监督学习

非监督模式识别(聚类)

- 实现并不知道类别,更没有类别已知的样本,根据样本特征将样本聚成几个类,使属于同一类的样本在一定意义上是相似的,而不同类别之间的样本有较大差异。这种学习过程称作非监督模式识别

1.4 模式识别系统举例

分类器的设计

1.5 模式识别系统的典型构成

一个模式识别系统通常包括原始数据的获取和预处理、特征提取与选择、分类获聚类、后处理四个主要部分

-

有已知样本情况:监督模式识别

-

信息获取与预处理——特征提取与选择——分类器设计(训练)

——分类决策(识别)

-

无已知样本情况::非监督模式识别

- 信息获取与预处理——特征提取与选择——聚类(自学习)——结果解释

监督模式识别和非监督模式识别的区别——训练样本

- 监督识别需要训练数据,根据训练样本设计分类器

- 而非监督模式识别不需要训练数据,是根据样本的相似性来进行分类的

特征提取与选择、分类器设计和聚类分析,乙级分类器和聚类结果的性能评价方法等是各种模式识别系统中具有共性的步骤,是整个系统的核心,也是模式识别学科研究的主要内容

二、统计决策方法

2.1 贝叶斯决策基础

-

两个先验知识:

-

先验概率:

P ( w 1 ) 和 P ( w 2 ) P(w_1)和P(w_2) P(w1)和P(w2)

-

类条件概率:

P ( x ∣ w 1 ) 和 P ( x ∣ w 2 ) P(x|w_1)和P(x|w_2) P(x∣w1)和P(x∣w2)

-

后验概率:

P ( w i ∣ x ) = P ( x ∣ w i ) P ( w i ) P ( x ) P(w_i|x)=\frac{P(x|w_i)P(w_i)}{P(x)} P(wi∣x)=P(x)P(x∣wi)P(wi)

-

根据后验概率进行决策,这个决策过程就是贝叶斯决策

-

先验概率:

P ( w i ) P(w_i) P(wi)

预先一直的或者可以估计的模式识别系统位于某种类型的概率。根据大量统计确定某类事物出现的比例,如P(男生)

-

类条件概率:

P ( x ∣ w i ) P(x|w_i) P(x∣wi)

类别状态为wi时,样本x出现的概率密度

-

全概率:

P ( x ) P(x) P(x)

样本x在所有类别里出现的概率之和,也称为x的全概率在两类问题的情况下:

p ( x ) = ∑ p ( x ∣ w j ) P ( w j ) , j = 1 , 2 p(x)=\sum p(x|w_j)P(w_j) ,j=1,2 p(x)=∑p(x∣wj)P(wj),j=1,2

-

后验概率:$ P(w_i|x) $

- 一个具体事物属于某种类别的概率

- 后验概率涉及一个具体事物,而先验概率是泛指一类事物,因此P(男生|X)和P(男生)是两个不同的概念

-

贝叶斯公式

P ( w i ∣ D ) = P ( D ∣ w i ) P ( w i ) P ( D ) P(w_i|D)=\frac{P(D|w_i)P(w_i)}{P(D)} P(wi∣D)=P(D)P(D∣wi)P(wi)

-

贝叶斯公示的两个创新点:

- 用概率表示所有形式的不确定性

- 引入了“先验”与“后验”的概念

-

贝叶斯决策

- 在类条件概率和先验概率已知(或者可以估计)的情况下,通过贝叶斯公式比较样本属于两类的后验概率,将类别决策为厚颜概率大的一类,这样做的目的是为了使总体错误率最小

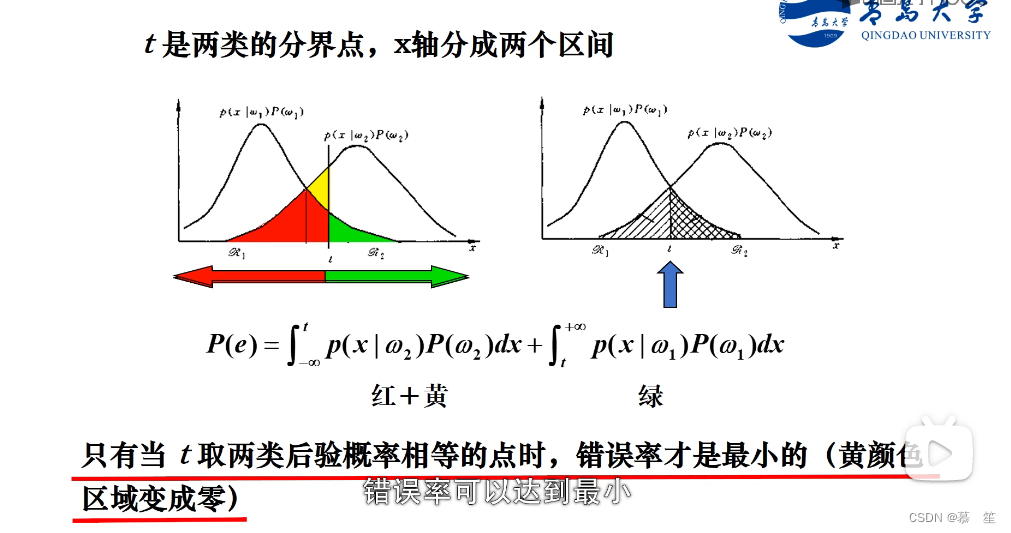

2.2 最小错误率贝叶斯决策

1、最小错误率

错误率是指平均错误率,其表达式为:

P ( e ) = ∫ P ( e , x ) d x = ∫ P ( e ∣ x ) p ( x ) d x P(e)=\int{P(e,x)dx}=\int{P(e|x)p(x)dx} P(e)=∫P(e,x)dx=∫P(e∣x)p(x)dx

对错误率求最小值可以写成:

m i n P ( e ) = ∫ P ( e , x ) d x = ∫ P ( e ∣ x ) p ( x ) d x minP(e)=\int{P(e,x)dx}=\int{P(e|x)p(x)}dx minP(e)=∫P(e,x)dx=∫P(e∣x)p(x)dx

2、最小错误率的贝叶斯决策规则的多种等价形式

1) P ( w i ) = m a x P ( w j ∣ x ) − > x ∈ w i P(w_i)=maxP(w_j|x)->x\in w_i P(wi)=maxP(wj∣x)−>x∈wi

2) p ( x ∣ w i ) P ( w i ) = m a x p ( x ∣ w j ) P ( w j ) — > x ∈ w i p(x|w_i)P(w_i)=max p(x|w_j)P(w_j) —>x\in w_i p(x∣wi)P(wi)=maxp(x∣wj)P(wj)—>x∈wi

3) l ( x ) = p ( x ∣ w i ) p ( x ∣ w I ) > P ( w 2 ) P ( w 1 ) − > x ∈ w i l(x)=\frac{p(x|w_i)}{p(x|w_I)}>\frac{P(w_2)}{P(w_1)} ->x\in w_i l(x)=p(x∣wI)p(x∣wi)>P(w1)P(w2)−>x∈wi

l ( x ) = p ( x ∣ w i ) p ( x ∣ w I ) x ∈ w i l(x)=\frac{p(x|w_i)}{p(x|w_I)}x\in w_i l(x)=p(x∣wI)p(x∣wi)x∈wi 其中,l(x)为似然比, P ( w 2 ) P ( w 1 ) \frac{P(w_2)}{P(w_1)} P(w1)P(w2) 为似然比阈值

4) h ( x ) = − ln l ( x ) = − ln p ( x ∣ w 1 ) + l n p ( x ∣ w 2 ) x ∈ w 1 h(x)=-\ln l(x)=-\ln p(x|w_1)+ln p(x|w_2)x\in w_1 h(x)=−lnl(x)=−lnp(x∣w1)+lnp(x∣w2)x∈w1

h ( x ) = − ln l ( x ) = − ln p ( x ∣ w 1 ) + l n p ( x ∣ w 2 ) > ln P ( w 1 ) P ( w 2 ) − > x ∈ w 2 h(x)=-\ln l(x)=-\ln p(x|w_1)+ln p(x|w_2)>\ln \frac{P(w_1)}{P(w_2)}->x\in w_2 h(x)=−lnl(x)=−lnp(x∣w1)+lnp(x∣w2)>lnP(w2)P(w1)−>x∈w2

2.3 最小风险贝叶斯决策

1、最小风险贝叶斯决策就是考虑各种错误造成不同时的算是造成的

(1)观察 x x x是d维随机向量 x = [ x 1 , x 2 , . . . , x d ] T x=[x_1,x_2,...,x_d]T x=[x1,x2,...,xd]T

(2)状态空间 Ω \Omega Ω由c个自然状态组成。 Ω = { w 1 , w 2 , . . . w c } \Omega=\{w_1,w_2,...w_c\} Ω={w1,w2,...wc}

(3)决策空间由a个决策 α , i = { 1 , 2 , . . . , a } 组成 \alpha,i=\{1,2,...,a\}组成 α,i={1,2,...,a}组成 γ = { α 1 , α 2 , . . . . , α a } \gamma=\{\alpha_1,\alpha_2,....,\alpha_a\} γ={α1,α2,....,αa}

a和c不同

(4)损失函数: λ ( α i , w j ) , i = 1 , 2... a , j = 1 , 2 , . . . c \lambda(\alpha_i,w_j),i=1,2...a,j=1,2,...c λ(αi,wj),i=1,2...a,j=1,2,...c

2、条件期望损失

R ( α i ∣ x ) = E [ λ ( α i , w j ) ] = ∑ j = 1 c λ ( α i , w j ) P ( w j ∣ x ) , i = 1 , 2 , . . . a R(\alpha_i|x)=E[\lambda(\alpha_i,w_j)]=\sum_{j=1}^{c}\lambda(\alpha_i,w_j)P(w_j|x),i=1,2,...a R(αi∣x)=E[λ(αi,wj)]=j=1∑cλ(αi,wj)P(wj∣x),i=1,2,...a

- 此式考虑的是对样本x采集表中某一种决策

a

i

a_i

ai时的损失的加权平均值

3、期望风险

R = ∫ R ( α ( x ) ∣ x ) p ( x ) d x R=\int R(\alpha(x)|x)p(x)dx R=∫R(α(x)∣x)p(x)dx

期望风险R反应对整个特征空间所有x的取值都采用相应的决策所带来的平均风险;

而条件风险 R ( a i ) ∣ x R(a_i)|x R(ai)∣x只是反映了对某一x的取值采取决策 a i a_i ai 所带来的风险

如果在采取每一个决策或行动时,都使条件风险最小,则 对所有的x做出决策时,其期望风险也必然最小。

4、最小风险贝叶斯决策规则

如果在采取每一个决策或行动时,都使条件风险最小,则对所有的x做出决策时,其期望风险也必然最小,这样的决策就是最小贝叶斯决策

2.4 贝叶斯分类器

我们对样本进行分类决策的过程其实就是建立分类器的过程

利用贝叶斯原理对样本进行分类的过程就是建立贝叶斯分类器的过程

1、贝叶斯分类器的原理:

- 通过某对象的先验概率,利用贝叶斯公式计算出其后验概率,选择具有最大后验概率的类作为该对象所属的类

在设计贝叶斯分类器的时候,主要包含两步:

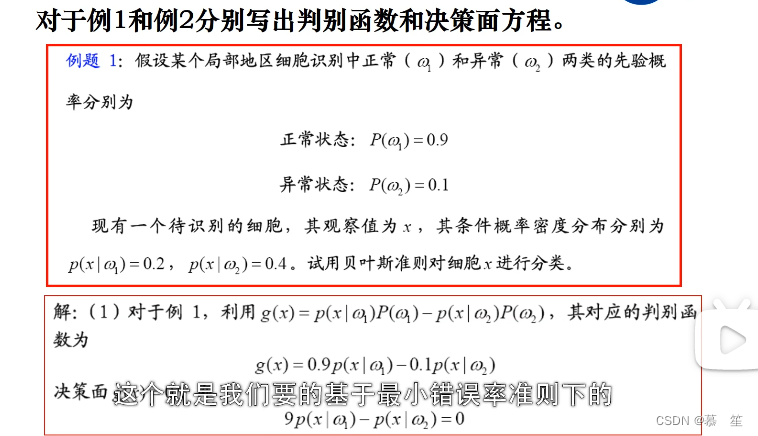

(1)判别函数:用于表达决策测规则的某些函数称为判别函数

(2)决策面:对于c类分类问题,按照决策规则可以把d维特征空间分成c个决策域,将划分决策域的边界称为决策面。

2、两类问题

(1)判别函数

g ( x ) = g 1 ( x ) − g 2 ( x ) g(x)=g_1(x)-g_2(x) g(x)=g1(x)−g2(x)

{ g ( x ) > 0 , 决策为 x ∈ w 1 g ( x ) 0,决策为x \in w_1 \\ g(x)g(x)0,决策为x∈w1g(x)决策面方程——>设计分类器

(1)判别函数

-

写出多个判别函数,通常定义一组判别函数 g i ( x ) g_i(x) gi(x), i = 1 , 2 , . . . c i=1,2,...c i=1,2,...c,也就是每一类别都对应一个判别函数。

-

定义判别规则的时候,如果对于一切j不等于i, g i ( x ) > g j ( x ) g_i(x)>g_j(x) gi(x)>gj(x)都成立,则将x归为 w i w_i wi类。

-

在最小错误率的判别规则下的判别函数

g i ( x ) = P ( w i ∣ x ) g_i(x)=P(w_i|x) gi(x)=P(wi∣x)

g i ( x ) = p ( x ∣ w i ) p ( w i ) g_i(x)=p(x|w_i)p(w_i) gi(x)=p(x∣wi)p(wi)

g i ( x ) = ln p ( x ∣ w i ) + ln P ( w i ) g_i(x)=\ln p(x|w_i)+\ln P(w_i) gi(x)=lnp(x∣wi)+lnP(wi)

(2)决策面方程

在多类问题里,特征空间被分为多个决策区域,相邻两个决策区域之间是由决策面分隔开的,所以相邻两个决策区域在决策面上的判别函数相等

(3)分类器设计

多类问题的分类器可以看作是一个计算c个判别函数,对c个判别函数进行比较,并选取与最大判别值对应的类别的网络和机器

例题

2.5 正态分布时的决策统计

一个贝叶斯分类器的机构可以由类条件概率密度 p ( x ∣ w i ) p(x|w_i) p(x∣wi)回我先验概率 P ( w i ) P(w_i) P(wi)来决定,而类条件概率密度在统计决策理论中起着重要的作用,在概率密度函数里面,正态分布,也被称为高斯分布 ,是人们研究最多的分布之一。

1、为什么要用正态分布函数

- 在客观世界中很多随机变量都服从或近似服从正态分布,对很多数据都可以做出正太分布的假设

- 另一个原因是正态分布在数学上具有很多好的性质,十分有利于数学分析。

2、正态分布的基础知识

1、单变量正态分布

概率密度定义为:

p ( x ) = 1 2 π e x p [ − 1 2 ( x − μ σ ) 2 ] p(x)=\frac{1}{\sqrt{2\pi}}exp[-\frac{1}{2}(\frac{x-\mu}{\sigma})^2 ] p(x)=2π 1exp[−21(σx−μ)2]

x为一维向量

μ \mu μ为随机变量x的数学期望(均值)

μ = E ( x ) = ∫ − ∞ ∞ x p ( x ) d x \mu=E(x)=\int_{-\infty}^{\infty}xp(x)dx μ=E(x)=∫−∞∞xp(x)dx

σ 2 \sigma^2 σ2为随机变量的方差; σ \sigma σ为均方差(标准差)

σ 2 = ∫ − ∞ ∞ ( x − μ ) 2 p ( x ) d x \sigma^2=\int_{-\infty}^{\infty}(x-\mu)^2p(x)dx σ2=∫−∞∞(x−μ)2p(x)dx

- 概率密度函数

p

(

w

i

∣

x

)

或

p

(

x

)

p(w_i|x)或p(x)

p(wi∣x)或p(x)完全由两个参数

μ

和

σ

\mu和\sigma

μ和σ决定

满足下列关系式:

p ( X ) ≥ 0 − ∞

- 概率密度函数

p

(

w

i

∣

x

)

或

p

(

x

)

p(w_i|x)或p(x)

p(wi∣x)或p(x)完全由两个参数

μ

和

σ

\mu和\sigma

μ和σ决定

-

- 通过某对象的先验概率,利用贝叶斯公式计算出其后验概率,选择具有最大后验概率的类作为该对象所属的类

- 此式考虑的是对样本x采集表中某一种决策

a

i

a_i

ai时的损失的加权平均值

- 在类条件概率和先验概率已知(或者可以估计)的情况下,通过贝叶斯公式比较样本属于两类的后验概率,将类别决策为厚颜概率大的一类,这样做的目的是为了使总体错误率最小

-

-

- 信息获取与预处理——特征提取与选择——聚类(自学习)——结果解释

-

-

- 实现并不知道类别,更没有类别已知的样本,根据样本特征将样本聚成几个类,使属于同一类的样本在一定意义上是相似的,而不同类别之间的样本有较大差异。这种学习过程称作非监督模式识别

- 已知类别,并且能够获得类别已知的训练样本,这种情况下建立分类器的问题属于监督学习问题,称为监督学习

- 统计模式识别的方法