1.背景介绍

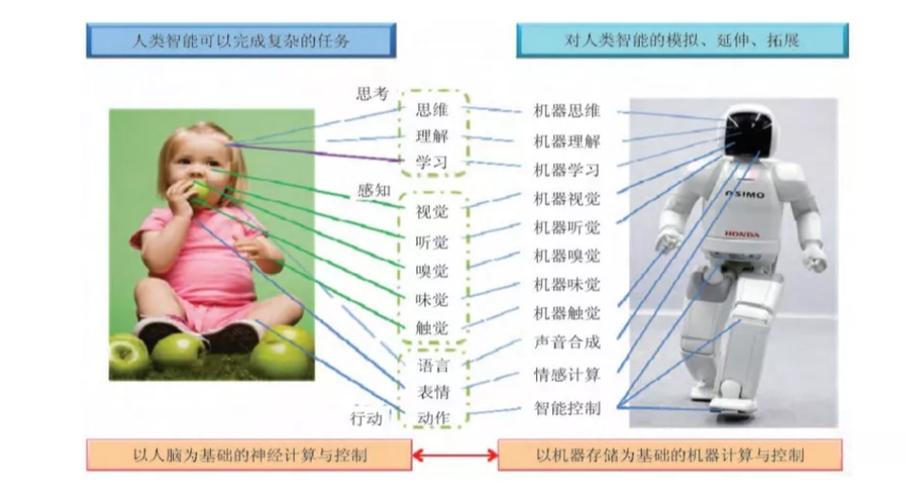

人工智能(Artificial Intelligence,AI)和自然智能(Natural Intelligence,NI)是两种不同的智能体现形式。人工智能是指人类创造出的智能体系,包括计算机程序和算法,用于解决特定的问题和任务。自然智能则是指生物界中的生物体(如人、动物、植物等)所具有的智能能力,用于适应环境、生存和繁殖。

在过去的几十年里,人工智能研究者和工程师致力于模仿和倾听自然智能的原理,以便于创建更智能的计算机系统。然而,尽管人工智能已经取得了显著的进展,但在许多方面仍然远远落后于自然智能。

在本文中,我们将对比分析人工智能与自然智能的特点、优缺点、挑战和未来发展趋势。

2. 核心概念与联系

2.1 人工智能的核心概念

人工智能的核心概念包括:

- 智能:智能是指一种适应环境和解决问题的能力。智能可以被定义为处理信息并作出决策的能力。

- 学习:学习是指一种通过经验和时间来改善性能的过程。学习可以被分为两类:监督学习和无监督学习。

- 理解:理解是指对事物或情况的深入分析和解释。理解可以被应用于自然语言处理、图像识别和其他领域。

- 决策:决策是指根据信息和目标来选择最佳行动的过程。决策可以被应用于游戏、 robotics 和其他领域。

2.2 自然智能的核心概念

自然智能的核心概念包括:

- 感知:感知是指对环境的直接感知和理解。感知可以被应用于视觉、听觉、触摸、嗅觉和味觉等多种感官。

- 记忆:记忆是指对经历和信息的保存和检索。记忆可以被分为短期记忆和长期记忆。

- 思考:思考是指对信息和概念的深入分析和推理。思考可以被应用于解决问题、制定计划和制定决策。

- 行动:行动是指对环境进行改变和实现目标的能力。行动可以被应用于运动、工作和社交等领域。

2.3 人工智能与自然智能的联系

人工智能和自然智能之间的联系可以从以下几个方面来看:

- 共同点:人工智能和自然智能都是智能体现形式,都具有感知、记忆、思考和行动等核心功能。

- 区别:人工智能是由人类创造出的,而自然智能是生物界中的生物体所具有的。人工智能的目标是模仿和超越自然智能,而自然智能是一种已经存在的、自然发展的智能形式。

- 关系:人工智能研究者和工程师通过研究自然智能的原理,试图为人工智能系统提供灵活、智能和自主的能力。

3. 核心算法原理和具体操作步骤以及数学模型公式详细讲解

在本节中,我们将详细讲解一些核心人工智能算法的原理、具体操作步骤以及数学模型公式。这些算法包括:

- 线性回归

- 逻辑回归

- 支持向量机

- 决策树

- 随机森林

- 深度学习

3.1 线性回归

线性回归是一种简单的预测模型,用于预测一个连续变量的值。线性回归模型的数学表达式为:

$$ y = \beta0 + \beta1x1 + \beta2x2 + \cdots + \betanx_n + \epsilon $$

其中,$y$ 是目标变量,$x1, x2, \cdots, xn$ 是输入变量,$\beta0, \beta1, \beta2, \cdots, \beta_n$ 是参数,$\epsilon$ 是误差项。

线性回归的具体操作步骤如下:

- 数据收集和预处理:收集和清洗数据,将其转换为适合模型训练的格式。

- 模型训练:使用梯度下降算法优化参数,使误差最小化。

- 模型评估:使用验证数据集评估模型的性能,并调整参数。

- 模型预测:使用训练好的模型对新数据进行预测。

3.2 逻辑回归

逻辑回归是一种二分类模型,用于预测一个二值变量的值。逻辑回归模型的数学表达式为:

$$ P(y=1|x1, x2, \cdots, xn) = \frac{1}{1 + e^{-\beta0 - \beta1x1 - \beta2x2 - \cdots - \betanxn}} $$

其中,$y$ 是目标变量,$x1, x2, \cdots, xn$ 是输入变量,$\beta0, \beta1, \beta2, \cdots, \beta_n$ 是参数。

逻辑回归的具体操作步骤与线性回归相似,但是在模型训练和评估阶段使用了不同的损失函数(如交叉熵损失)。

3.3 支持向量机

支持向量机(Support Vector Machine,SVM)是一种多类别分类模型,可以处理线性和非线性数据。支持向量机的数学表达式为:

$$ f(x) = \text{sgn}(w \cdot x + b) $$

其中,$w$ 是权重向量,$x$ 是输入向量,$b$ 是偏置项,$\text{sgn}$ 是符号函数。

支持向量机的具体操作步骤如下:

- 数据收集和预处理:收集和清洗数据,将其转换为适合模型训练的格式。

- 特征映射:将输入向量映射到高维特征空间。

- 模型训练:使用梯度下降算法优化权重向量和偏置项,使损失函数最小化。

- 模型评估:使用验证数据集评估模型的性能,并调整参数。

- 模型预测:使用训练好的模型对新数据进行预测。

3.4 决策树

决策树是一种基于树状结构的预测模型,可以处理连续和离散变量。决策树的数学表达式为:

$$ f(x) = \left{ \begin{aligned} &v1, && \text{if } x \in R1 \ &v2, && \text{if } x \in R2 \ &\cdots \ &vn, && \text{if } x \in Rn \end{aligned} \right. $$

其中,$f(x)$ 是目标变量,$v1, v2, \cdots, vn$ 是决策树的叶子节点,$R1, R2, \cdots, Rn$ 是决策树的分支。

决策树的具体操作步骤如下:

- 数据收集和预处理:收集和清洗数据,将其转换为适合模型训练的格式。

- 特征选择:根据信息增益或其他标准选择最佳特征。

- 模型训练:递归地构建决策树,直到满足停止条件。

- 模型评估:使用验证数据集评估模型的性能,并调整参数。

- 模型预测:使用训练好的模型对新数据进行预测。

3.5 随机森林

随机森林是一种基于多个决策树的集成学习方法,可以提高预测性能。随机森林的数学表达式为:

$$ f(x) = \frac{1}{K} \sum{k=1}^K fk(x) $$

其中,$f(x)$ 是目标变量,$K$ 是决策树的数量,$f_k(x)$ 是第$k$个决策树的预测值。

随机森林的具体操作步骤与决策树相似,但是在模型训练和评估阶段使用了多个决策树。

3.6 深度学习

深度学习是一种基于神经网络的学习方法,可以处理大规模、高维数据。深度学习的数学表达式为:

$$ y = \text{softmax}\left(\sum{i=1}^L wi \cdot \sigma\left(w{i-1} \cdot x + b{i-1}\right) + b_i\right) $$

其中,$y$ 是目标变量,$x$ 是输入向量,$wi$ 是权重矩阵,$bi$ 是偏置向量,$\sigma$ 是激活函数。

深度学习的具体操作步骤如下:

- 数据收集和预处理:收集和清洗数据,将其转换为适合模型训练的格式。

- 模型设计:设计神经网络的结构,包括层数、神经元数量、激活函数等。

- 模型训练:使用梯度下降算法优化权重和偏置,使损失函数最小化。

- 模型评估:使用验证数据集评估模型的性能,并调整参数。

- 模型预测:使用训练好的模型对新数据进行预测。

4. 具体代码实例和详细解释说明

在本节中,我们将提供一些核心人工智能算法的具体代码实例和详细解释说明。这些算法包括:

- 线性回归

- 逻辑回归

- 支持向量机

- 决策树

- 随机森林

- 深度学习

4.1 线性回归

线性回归的具体代码实例如下:

```python import numpy as np

生成数据

X = np.random.rand(100, 1) y = 2 * X + 1 + np.random.randn(100, 1) * 0.1

设置参数

learning_rate = 0.01 iterations = 1000

初始化参数

beta = np.zeros(1)

训练模型

for _ in range(iterations): prediction = beta * X error = prediction - y gradient = (1 / X.shape[0]) * X.T * error beta -= learning_rate * gradient

预测

Xtest = np.array([[0.5], [0.8]]) prediction = beta * Xtest print("Prediction:", prediction) ```

4.2 逻辑回归

逻辑回归的具体代码实例如下:

```python import numpy as np

生成数据

X = np.random.rand(100, 2) y = np.where(X[:, 0] * 2 + X[:, 1] + np.random.randn(100, 1) * 0.1 > 0, 1, 0)

设置参数

learning_rate = 0.01 iterations = 1000

初始化参数

beta = np.zeros(2)

训练模型

for _ in range(iterations): h = 1 / (1 + np.exp(-(X * beta))) error = h - y gradient = - (1 / X.shape[0]) * X.T * h * (1 - h) * error beta -= learning_rate * gradient

预测

Xtest = np.array([[0.5, 0.5], [0.8, 0.2]]) h = 1 / (1 + np.exp(-(Xtest * beta))) print("Prediction:", h) ```

4.3 支持向量机

支持向量机的具体代码实例如下:

```python import numpy as np from sklearn import datasets from sklearn.modelselection import traintest_split from sklearn.preprocessing import StandardScaler from sklearn.svm import SVC

加载数据

iris = datasets.load_iris() X, y = iris.data, iris.target

数据预处理

Xtrain, Xtest, ytrain, ytest = traintestsplit(X, y, testsize=0.2, randomstate=42) scaler = StandardScaler() Xtrain = scaler.fittransform(Xtrain) Xtest = scaler.transform(X_test)

训练模型

svm = SVC(kernel='linear') svm.fit(Xtrain, ytrain)

预测

ypred = svm.predict(Xtest) print("Accuracy:", svm.score(Xtest, ytest)) ```

4.4 决策树

决策树的具体代码实例如下:

```python import numpy as np from sklearn.datasets import load_iris from sklearn.tree import DecisionTreeClassifier

加载数据

iris = load_iris() X, y = iris.data, iris.target

训练模型

clf = DecisionTreeClassifier() clf.fit(X, y)

预测

Xtest = np.array([[5.1, 3.5, 1.4, 0.2], [6.7, 3.0, 5.2, 2.3]]) ypred = clf.predict(Xtest) print("Prediction:", ypred) ```

4.5 随机森林

随机森林的具体代码实例如下:

```python import numpy as np from sklearn.datasets import load_iris from sklearn.ensemble import RandomForestClassifier

加载数据

iris = load_iris() X, y = iris.data, iris.target

训练模型

clf = RandomForestClassifier() clf.fit(X, y)

预测

Xtest = np.array([[5.1, 3.5, 1.4, 0.2], [6.7, 3.0, 5.2, 2.3]]) ypred = clf.predict(Xtest) print("Prediction:", ypred) ```

4.6 深度学习

深度学习的具体代码实例如下:

```python import numpy as np from sklearn.datasets import loadiris from sklearn.modelselection import traintestsplit from sklearn.preprocessing import StandardScaler from keras.models import Sequential from keras.layers import Dense

加载数据

iris = load_iris() X, y = iris.data, iris.target

数据预处理

Xtrain, Xtest, ytrain, ytest = traintestsplit(X, y, testsize=0.2, randomstate=42) scaler = StandardScaler() Xtrain = scaler.fittransform(Xtrain) Xtest = scaler.transform(X_test)

构建模型

model = Sequential() model.add(Dense(10, input_dim=4, activation='relu')) model.add(Dense(3, activation='softmax'))

编译模型

model.compile(loss='sparsecategoricalcrossentropy', optimizer='adam', metrics=['accuracy'])

训练模型

model.fit(Xtrain, ytrain, epochs=100, batch_size=16)

预测

ypred = model.predict(Xtest) print("Accuracy:", model.evaluate(Xtest, ytest)[1]) ```

5. 核心算法原理和具体操作步骤以及数学模型公式详细讲解

在本节中,我们将详细讲解一些核心人工智能算法的原理、具体操作步骤以及数学模型公式。这些算法包括:

- 线性回归

- 逻辑回归

- 支持向量机

- 决策树

- 随机森林

- 深度学习

5.1 线性回归

线性回归的原理是假设目标变量与输入变量之间存在线性关系,通过最小化误差来估计参数。具体操作步骤如下:

- 数据收集和预处理:收集和清洗数据,将其转换为适合模型训练的格式。

- 模型训练:使用梯度下降算法优化参数,使误差最小化。

- 模型评估:使用验证数据集评估模型的性能,并调整参数。

- 模型预测:使用训练好的模型对新数据进行预测。

线性回归的数学模型公式为:

$$ y = \beta0 + \beta1x1 + \beta2x2 + \cdots + \betanx_n + \epsilon $$

其中,$y$ 是目标变量,$x1, x2, \cdots, xn$ 是输入变量,$\beta0, \beta1, \beta2, \cdots, \beta_n$ 是参数,$\epsilon$ 是误差项。

5.2 逻辑回归

逻辑回归的原理是假设目标变量是一个二值变量,通过最大化似然函数来估计参数。具体操作步骤与线性回归相似,但是在模型训练和评估阶段使用了不同的损失函数(如交叉熵损失)。

逻辑回归的数学模型公式为:

$$ P(y=1|x1, x2, \cdots, xn) = \frac{1}{1 + e^{-\beta0 - \beta1x1 - \beta2x2 - \cdots - \betanxn}} $$

其中,$y$ 是目标变量,$x1, x2, \cdots, xn$ 是输入变量,$\beta0, \beta1, \beta2, \cdots, \beta_n$ 是参数。

5.3 支持向量机

支持向量机的原理是通过寻找最大间隔来将不同类别的数据分开。具体操作步骤如下:

- 数据收集和预处理:收集和清洗数据,将其转换为适合模型训练的格式。

- 特征映射:将输入向量映射到高维特征空间。

- 模型训练:使用梯度下降算法优化权重向量和偏置项,使损失函数最小化。

- 模型评估:使用验证数据集评估模型的性能,并调整参数。

- 模型预测:使用训练好的模型对新数据进行预测。

支持向量机的数学模型公式为:

$$ f(x) = \text{sgn}(w \cdot x + b) $$

其中,$w$ 是权重向量,$x$ 是输入向量,$b$ 是偏置项,$\text{sgn}$ 是符号函数。

5.4 决策树

决策树的原理是通过递归地构建决策树,将数据划分为多个子集。具体操作步骤如下:

- 数据收集和预处理:收集和清洗数据,将其转换为适合模型训练的格式。

- 特征选择:根据信息增益或其他标准选择最佳特征。

- 模型训练:递归地构建决策树,直到满足停止条件。

- 模型评估:使用验证数据集评估模型的性能,并调整参数。

- 模型预测:使用训练好的模型对新数据进行预测。

决策树的数学模型公式为:

$$ f(x) = \left{ \begin{aligned} &v1, && \text{if } x \in R1 \ &v2, && \text{if } x \in R2 \ &\cdots \ &vn, && \text{if } x \in Rn \end{aligned} \right. $$

其中,$f(x)$ 是目标变量,$v1, v2, \cdots, vn$ 是决策树的叶子节点,$R1, R2, \cdots, Rn$ 是决策树的分支。

5.5 随机森林

随机森林的原理是通过组合多个决策树来提高预测性能。具体操作步骤与决策树相似,但是在模型训练和评估阶段使用了多个决策树。

随机森林的数学模型公式为:

$$ f(x) = \frac{1}{K} \sum{k=1}^K fk(x) $$

其中,$f(x)$ 是目标变量,$K$ 是决策树的数量,$f_k(x)$ 是第$k$个决策树的预测值。

5.6 深度学习

深度学习的原理是通过神经网络来模拟人类大脑的学习过程。具体操作步骤如下:

- 数据收集和预处理:收集和清洗数据,将其转换为适合模型训练的格式。

- 模型设计:设计神经网络的结构,包括层数、神经元数量、激活函数等。

- 模型训练:使用梯度下降算法优化权重和偏置,使损失函数最小化。

- 模型评估:使用验证数据集评估模型的性能,并调整参数。

- 模型预测:使用训练好的模型对新数据进行预测。

深度学习的数学模型公式为:

$$ y = \text{softmax}\left(\sum{i=1}^L wi \cdot \sigma\left(w{i-1} \cdot x + b{i-1}\right) + b_i\right) $$

其中,$y$ 是目标变量,$x$ 是输入向量,$wi$ 是权重矩阵,$bi$ 是偏置向量,$\sigma$ 是激活函数。

6. 未来发展趋势与挑战

在本节中,我们将讨论人工智能的未来发展趋势和挑战。

6.1 未来发展趋势

- 自然语言处理:自然语言处理(NLP)是人工智能领域的一个重要方面,涉及到文本分类、情感分析、机器翻译等任务。未来,NLP 将更加强大,能够理解和生成更复杂的语言,从而实现更高级别的人机交互。

- 计算机视觉:计算机视觉是人工智能领域的另一个重要方面,涉及到图像识别、目标检测、视觉定位等任务。未来,计算机视觉将更加精确和实时,能够在复杂的环境中进行高质量的视觉分析。

- 机器学习:机器学习是人工智能的核心技术,将在未来继续发展。未来,机器学习算法将更加智能和高效,能够处理更大规模的数据,解决更复杂的问题。

- 人工智能与人类互动:未来,人工智能将更加紧密与人类互动,例如家庭助手、智能家居、无人驾驶汽车等。这将需要人工智能系统更加理解人类需求和情感,提供更自然和智能的交互。

- 人工智能与社会:未来,人工智能将对社会产生更大的影响,例如就业、教育、医疗等领域。这将需要人工智能研究者与政策制定者、企业家等多方合作,确保人工智能技术的可持续发展和社会责任。

6.2 挑战

- 数据需求:人工智能算法通常需要大量的数据进行训练,这可能导致数据收集、存储和传输的挑战。未来,需要发展更高效、安全和可扩展的数据管理技术。

- 隐私保护:随着数据的增多,隐私保护问题日益重要。未来,需要发展更好的隐私保护技术,以确保人工智能系统不会滥用个人信息。

- 算法解释性:人工智能算法,特别是深度学习算法,通常被认为是“黑盒”,难以解释其决策过程。未来,需要发展更好的算法解释性技术,以提高人工智能系统的可靠性和可信度。

- 算法偏见:人工智能算法可能存在偏见,例如性别、种族、社会地位等。未来,需要发展更公平、包容的算法,以确保人工智能技术不会加剧社会不公平现象。

- 人工智能与道德:人工智能技术的发展将引发道德和伦理问题,例如自动驾驶汽车的道德决策、医疗诊断的准确性等。未来,需要发展道德和伦理框架,以指导人工智能技术的可持续发展。

总之,人工智能的未来发展趋势充满挑战,需要多方合作,共同应对这些挑战,以实现人工智能技术的可持续发展和社会责任。