iclr 2024 reviewer 评分 5668

1 intro

- 大模型网络剪枝的paper

- 在努力保持性能的同时,舍弃网络权重的一个子集

- 现有方法

- 要么需要重新训练

- 这对于十亿级别的LLMs来说往往不现实

- 要么需要解决依赖于二阶信息的权重重建问题

- 这同样可能带来高昂的计算成本

- 要么需要重新训练

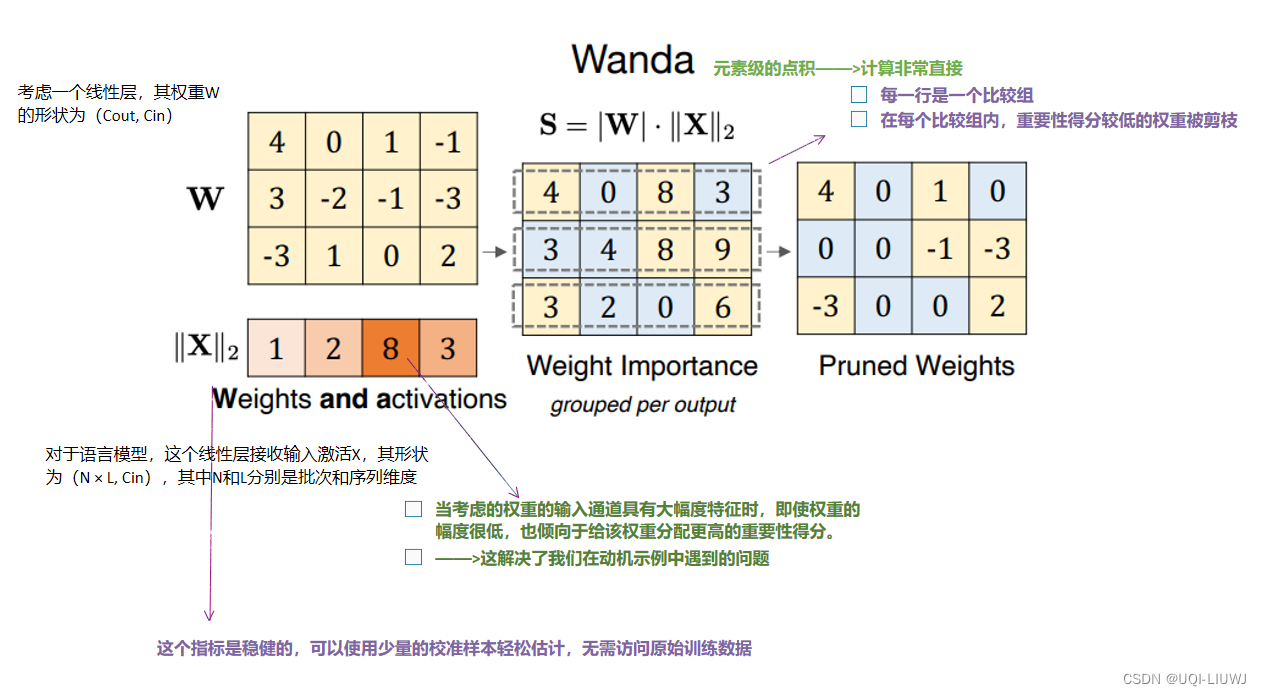

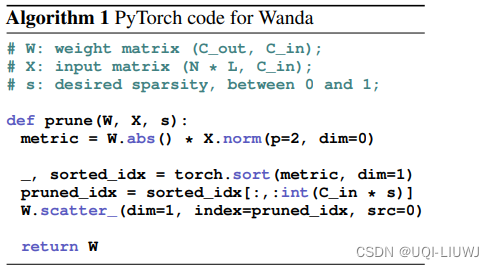

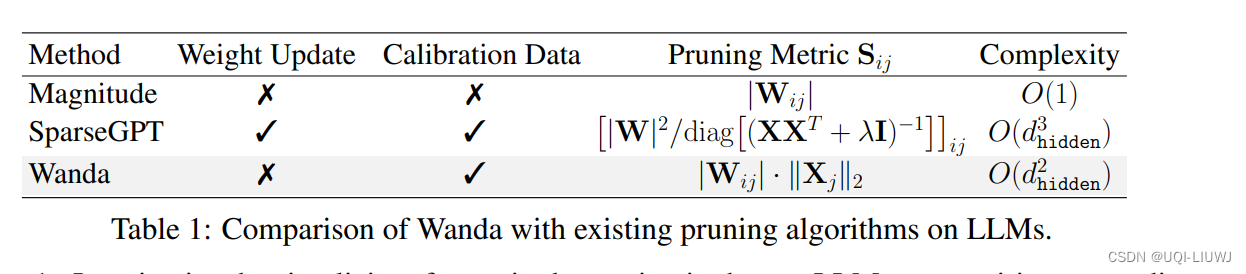

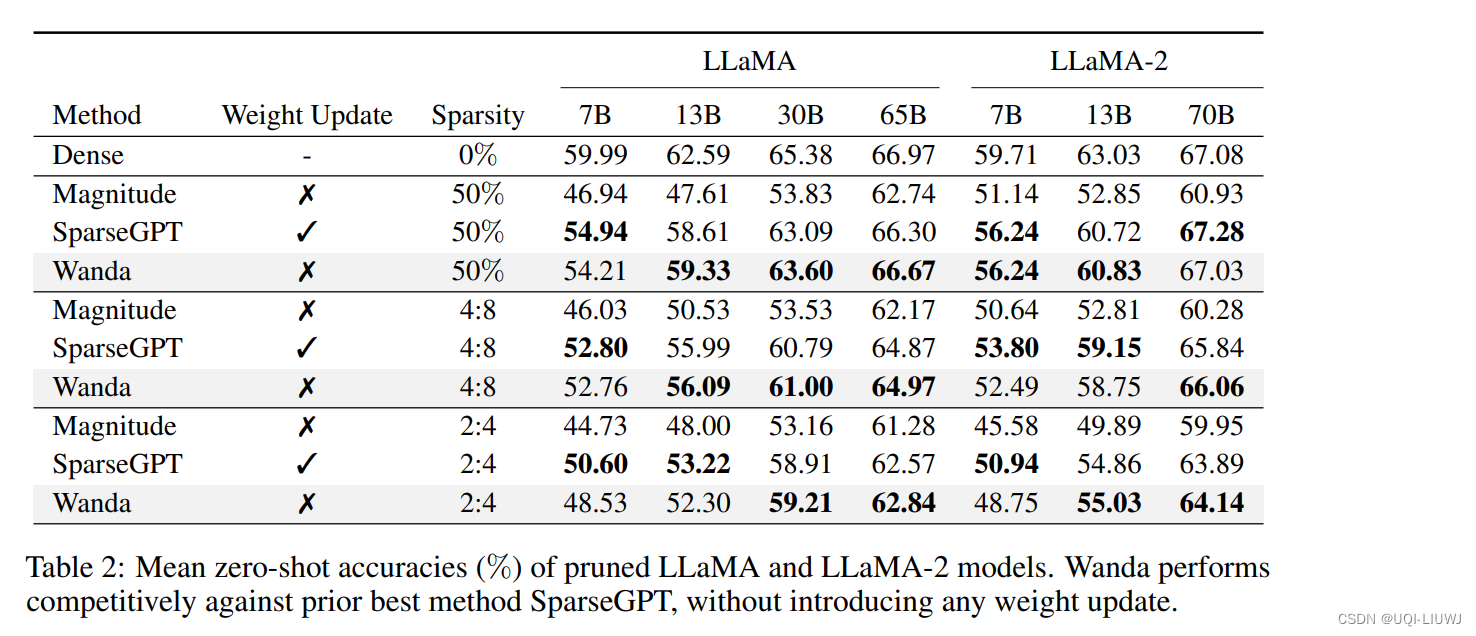

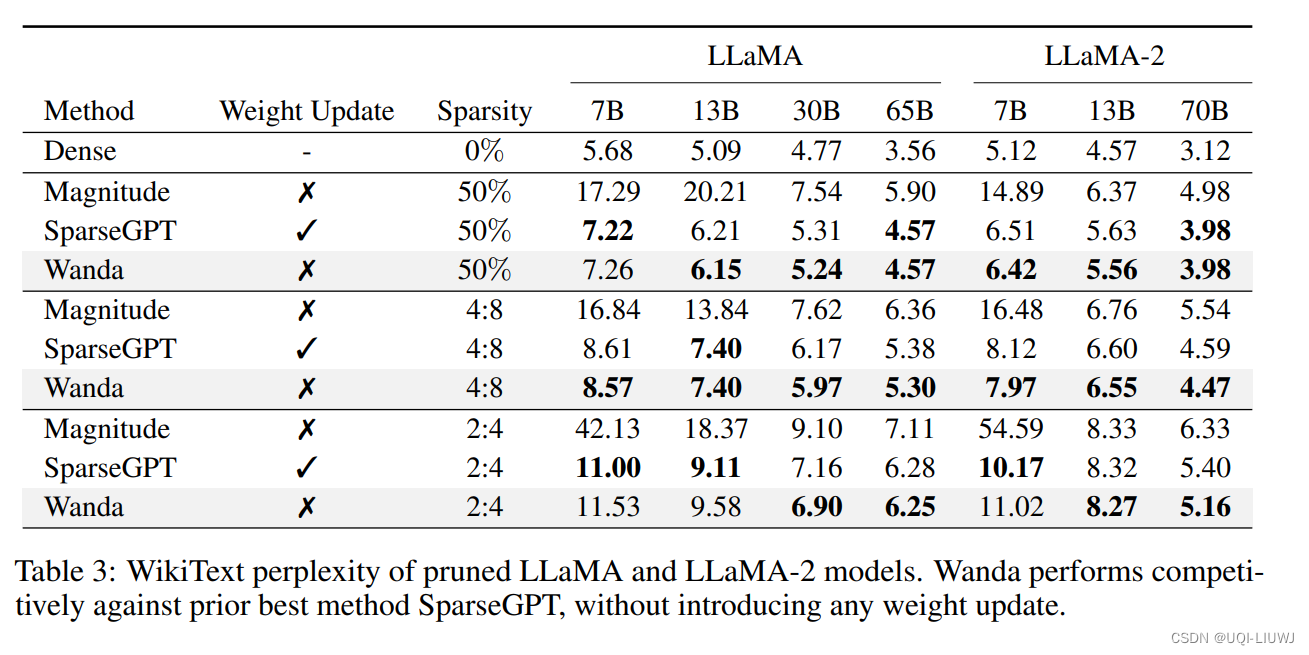

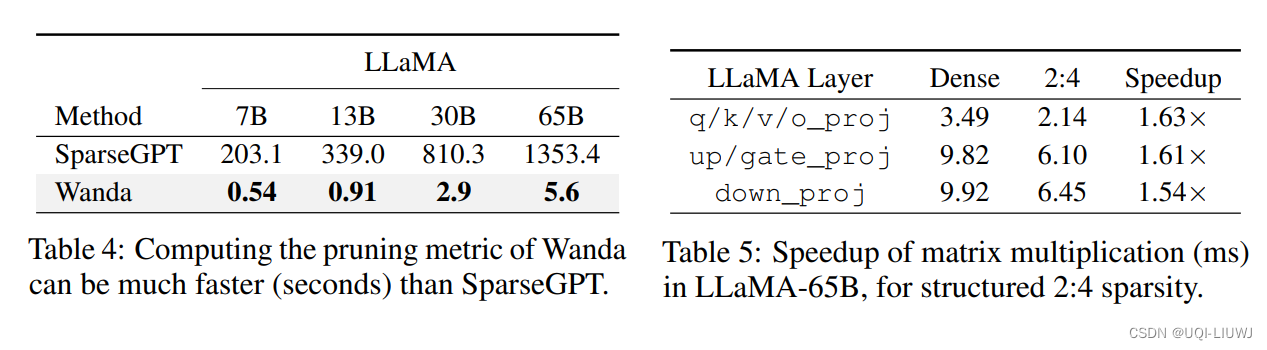

- ——>引入了一种新颖、简单且有效的剪枝方法,名为Wanda (Pruning by Weights and activations)

2 方法

2.1 motivation

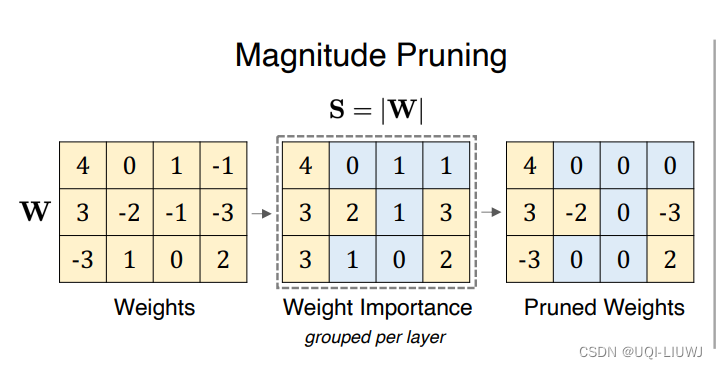

- 考虑一个带有两个输入及其对应权重的神经元:y = w1x1 + w2x2,其中|w1| ≤ |w2|。

- 现在假设目标是选择一个权重进行移除,同时使输出变化最小。

- 标准的幅度剪枝方法总是会移除权重w1

- 如果输入特征x1和x2的幅度相似,这可能是一个好策略。

- 然而,最近在LLMs中观察到,两个输入特征的规模可能差异很大。例如,可能|x1| ≫ |x2|,结果是|w1x1| ≫ |w2x2|。

- 在这种情况下,我们应该移除权重w2,因为这种移除明显对神经元输出y的影响小于移除权重w1。

- 考虑一个带有两个输入及其对应权重的神经元:y = w1x1 + w2x2,其中|w1| ≤ |w2|。