博主猫头虎的技术世界

🌟 欢迎来到猫头虎的博客 — 探索技术的无限可能!

专栏链接:

🔗 精选专栏:

- 《面试题大全》 — 面试准备的宝典!

- 《IDEA开发秘籍》 — 提升你的IDEA技能!

- 《100天精通鸿蒙》 — 从Web/安卓到鸿蒙大师!

- 《100天精通Golang(基础入门篇)》 — 踏入Go语言世界的第一步!

- 《100天精通Go语言(精品VIP版)》 — 踏入Go语言世界的第二步!

领域矩阵:

🌐 猫头虎技术领域矩阵:

深入探索各技术领域,发现知识的交汇点。了解更多,请访问:

- 猫头虎技术矩阵

- 新矩阵备用链接

文章目录

- 推动全球AI大模型发展的重量级开源大模型Grok-1到底是什么? 🌍🤖

- 引言

- 正文

- Grok-1基本信息介绍 📊

- 开始使用Grok-1

- 模型规格详解

- 详细的代码案例

- 下载权重

- QA环节

- 参考资料

- 表格总结

- 总结与未来展望

- 温馨提示

推动全球AI大模型发展的重量级开源大模型Grok-1到底是什么? 🌍🤖

摘要: 在本篇博客中,我们将深入探讨Grok-1,这个由xAI团队开发的3140亿参数的混合专家模型。Grok-1不仅仅是一个模型,它是AI领域的一次重大突破,代表了大模型发展的未来方向。这篇文章将覆盖Grok-1的基本信息、如何开始使用、模型规格、下载权重的方法以及其在Apache 2.0许可证下的开放性。无论您是AI领域的新手还是资深专家,本文都将带给您宝贵的见解和知识。关键词包括:Grok-1, 大模型, 开源, 混合专家模型, 参数, Apache 2.0许可证, AI技术, 机器学习, 深度学习。

引言

各位粉丝们,大家好,我是猫头虎, 今天我们要一起探索的是一个又可以遥遥领先的话题——Grok-1大模型。在AI的世界里,大模型的发展正以前所未有的速度推进科技的边界,而Grok-1无疑是这场变革中的佼佼者。让我们一起深入了解Grok-1,看看它为何能成为推动全球AI大模型发展的重量级开源大模型。

正文

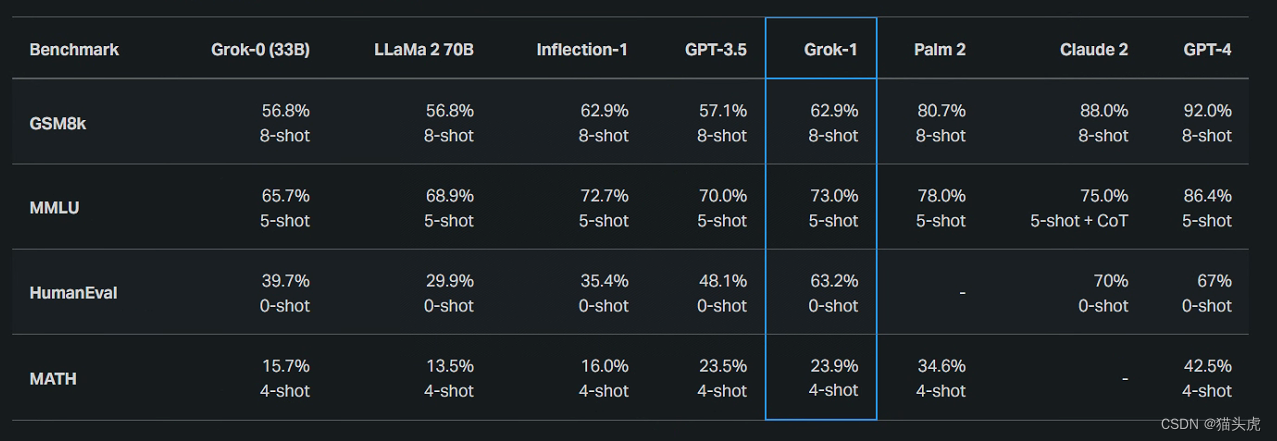

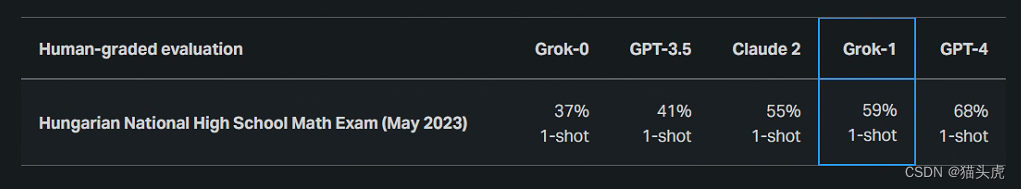

Grok-1基本信息介绍 📊

Grok-1是xAI团队从零开始训练的一个拥有3140亿参数的混合专家模型。这个模型是在2023年10月完成预训练的,它的权重和架构现在已经在Apache 2.0许可证下开放发布。

开始使用Grok-1

要开始使用Grok-1,您需要按照官方GitHub仓库上的指南进行操作。这包括安装必要的依赖、下载模型权重、并运行示例代码。

模型规格详解

- 参数量: 3140亿

- 架构: 8个专家的混合(MoE)

- 每个代币使用的专家: 2个

- 层数: 64

- 注意力头: 查询48个,键/值8个

- 嵌入大小: 6144

- 序列化: 使用131,072个令牌的SentencePiece

- 其他特性: 包括旋转嵌入(RoPE)、激活分片、8位量化

- 最大序列长度: 8192个令牌

详细的代码案例

为了使您能够快速上手Grok-1,以下是一个简单的代码示例,展示了如何加载模型并在测试输入上从模型中采样:

pip install -r requirements.txt python run.py

这段脚本会加载检查点并在测试输入上从模型中采样。

下载权重

您可以使用下面的磁力链接或直接通过HuggingFace 🤗 Hub下载Grok-1的权重。

magnet:?xt=urn:btih:5f96d43576e3d386c9ba65b883210a393b68210e&tr=https%3A%2F%2Facademictorrents.com%2Fannounce.php&tr=udp%3A%2F%2Ftracker.coppersurfer.tk%3A6969&tr=udp%3A%2F%2Ftracker.opentrackr.org%3A1337%2Fannounce

或者:

git clone https://github.com/xai-org/grok-1.git && cd grok-1 pip install huggingface_hub[hf_transfer] huggingface-cli download xai-org/grok-1 --repo-type model --include ckpt-0/* --local-dir checkpoints --local-dir-use-symlinks False

QA环节

Q: Grok-1模型适用于哪些AI任务?

A: Grok-1是一个通用模型,尽管它在发布时没有针对任何特定任务进行微调,但它的大规模和强大的参数使其适用于多种AI任务,包括自然语言处理、机器翻译、内容生成等。

Q: 如何优化Grok-1的性能?

A: 优化Grok-1的性能可以通过多种方式,包括使用更高效的硬件、对模型进行微调以适应特定的任务,以及利用激活分片和8位量化等特性。

参考资料

- Grok-1官方GitHub仓库

- Apache 2.0许可证

表格总结

特性 详情 参数量 3140亿 架构 混合专家模型 训练数据 大量文本数据 开源许可 Apache 2.0 总结与未来展望

Grok-1的发布不仅是xAI团队技术实力的展示,也是开源社区和AI研究者的一大福音。它的高参数量、混合专家模型架构以及开放性,预示着AI大模型未来发展的新趋势。随着更多的研究者和开发者开始使用和改进Grok-1,我们期待看到AI技术在各个领域的更多突破。

温馨提示

如果对本文有任何疑问,或想深入了解更多关于Grok-1的信息,欢迎点击下方名片,了解更多详细信息。让我们一起在AI的浪潮中乘风破浪,探索未知的无限可能!

👉 更多信息:有任何疑问或者需要进一步探讨的内容,欢迎点击下方文末名片获取更多信息。我是猫头虎博主,期待与您的交流! 🦉💬

🚀 技术栈推荐:

GoLang, Git, Docker, Kubernetes, CI/CD, Testing, SQL/NoSQL, gRPC, Cloud, Prometheus, ELK Stack

💡 联系与版权声明:

📩 联系方式:

- 微信: Libin9iOak

- 公众号: 猫头虎技术团队

⚠️ 版权声明:

本文为原创文章,版权归作者所有。未经许可,禁止转载。更多内容请访问猫头虎的博客首页。

点击下方名片,加入猫头虎领域社群矩阵。一起探索科技的未来,共同成长。

🔗 猫头虎社群 | 🔗 Go语言VIP专栏| 🔗 GitHub 代码仓库 | 🔗 Go生态洞察专栏